#7. 딥러닝과 깊은 퍼셉트론

2022. 11. 1. 15:40

Update Log

| 22.10.12 First Update

딥러닝

- 다층 퍼셉트론에 은닉층을 여러개 추가하면 깊은 신경망이 된다.

- 딥러닝은 깊은 신경망을 학습시키는 알고리즘이다.

- 딥러닝은 새로운 응용을 창출하고, 인공지능 제품의 성능을 획기적으로 향상시켰다.

- 현대의 기계학습을 주도하였다.

딥러닝의 등장

- 1980년대에 이미 깊은 신경망의 아이디어는 등장했다.

- 하지만 이는 실현이 불가능했다.

- 깊은 신경망은 학습이 안되기 때문이다.

- 그래디언트의 소멸 문제.

- 작은 훈련집합

- 과다한 계산시간 (값비싼 슈퍼컴퓨터)

- 이러한 실망스러운 상황에서도 꾸준한 연구를 했다.

- 학습률에 따른 성능 변화 양상을 보였다.

- 모멘텀의 변화를 주었다.

- 은닉 노드 수에 따른 성능 변화 양상을 보였다.

- 데이터 전처리의 영향을 받았다.

- 활성 함수의 영향을 받았다.

- 규제 기법의 영향을 받았다

딥러닝의 기술 혁신 요인

- 컨볼루션 신경망 (CNN) 이 딥러닝의 가능성을 열었다.

- 값싼 GPU가 등장했다.

- 인터넷 덕분으로 학습 데이터가 크게 늘어났다.

- 계산은 단순한데 성능이 더 좋은 활성함수가 나왔다.

- ReLU

- 과잉적합(Overfitting) 을 방지하는데 효과적인 다양한 규제 기법이 나왔다.

- 층별 예비학습 기법이 개발되었다.

특징학습의 부각

- 고전적인 다층 퍼셉트론

- 은닉층은 특징 추출기이다.

- 얕은 구조이므로 센서로 획득한 원래 패턴을 그대로 입력하면 낮은 성능을 보인다.

- 따라서 사람이 수작업 특징을 구상하고 구현하여 신경망에 입력해야 한다.

- 현대 기계학습 (딥러닝)

- 특징학습

- 특징 추출을 학습으로 설계한다.

- 앞단계 은닉층은 에지나 코너와 같은 저급 특징들을 추출한다.

- 뒷단계 은닉층은 추상적인 형태의 고급 특징들을 추출한다

- 특징 학습이 강력해짐에 따라서

- 기존 응용에서 획기적인 성능 향상이 보인다.

- 영상인식, 음성인식, 언어번역

- 새로운 응용을 창출한다.

- 분류나 회귀뿐 아니라 생성 모델이나 화소 수준의 영상분할

- CNN과 LSTM의 협력 모델 등이 가능해진다.

- 기존 응용에서 획기적인 성능 향상이 보인다.

- 통째 학습 (End-to-End Learning)

- 원래 패턴이 신경망의 입력이다.

깊은 다층 퍼셉트론 구조와 동작

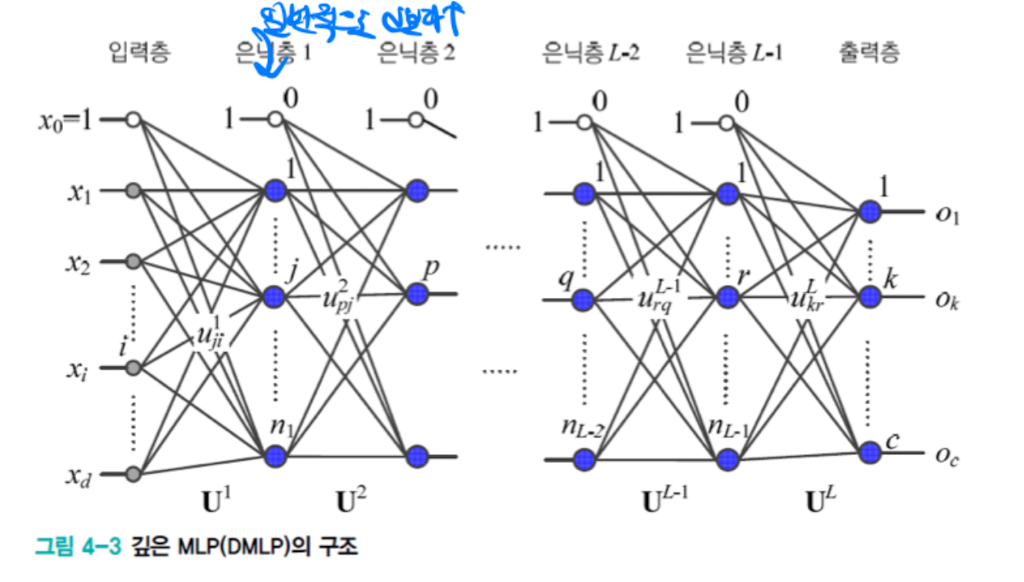

깊은 MLP( DMLP, Deep MLP) 의 구조

- 입력층 (d+1 개의 노드) 와 출력층 (c 개의 노드)

- L-1 개의 은닉층 (입력층은 0번째 은닉층, 출력층은 L번째 은닉층으로 간주)

- i번째 은닉층의 노드 수를 ni 로 표기한다.

DMLP의 가중치 행렬

- 가중치에 대한 표현식은 MLP와 동일하지만 l 이라는 층이 또 생겼으므로 이를 주의해야 한다.

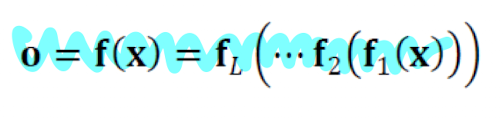

DMLP 의 동작

- 입력층의 특징 벡터를 내부 표현으로 바꾸어 쓴 것이다.

- l 번째 은닉층의 j 번째 노드의 연산을 식으로 쓴 것이다.

- 행렬 표기를 이용하여 l 번째 층의 연산 전체를 쓴 것이다.

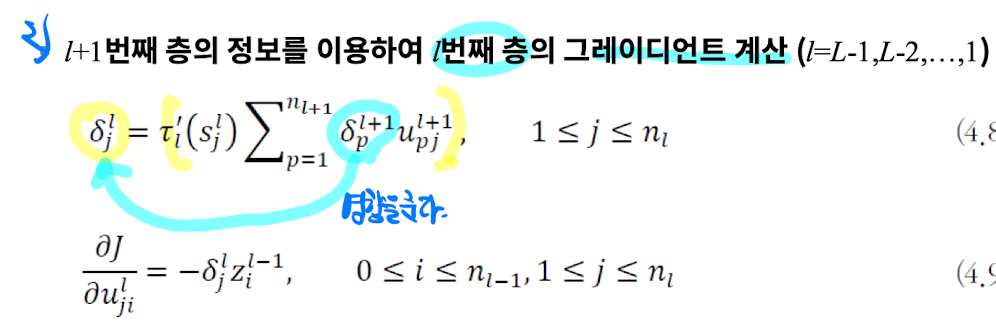

MDLP 의 오류 역전파

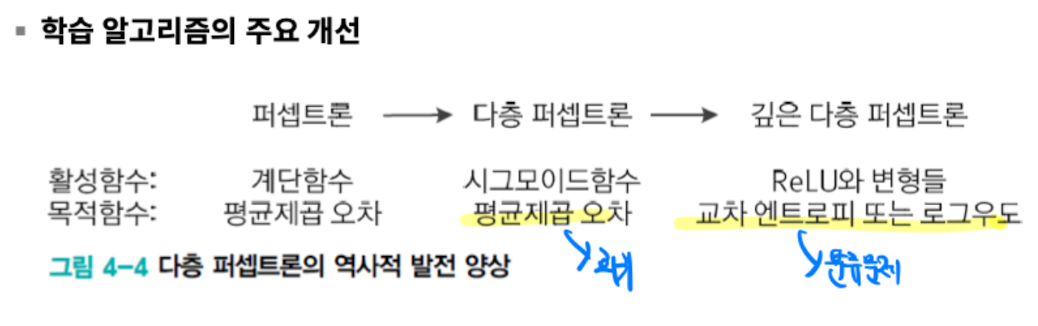

역사적인 고찰

'STUDY > 인공지능' 카테고리의 다른 글

| #9. 딥러닝 주요 최적화 방법 (0) | 2022.11.01 |

|---|---|

| #8. Pytorch 실습 (0) | 2022.11.01 |

| #6. 다층 퍼셉트론 및 딥러닝 기초 (0) | 2022.11.01 |

| #5. 최적화 이론 (1) | 2022.11.01 |

| #4. 기계학습 수학2 (1) | 2022.11.01 |